はじめに

「今日のChatGPT、なんだか挙動がおかしくないか?」

もしあなたが日々の業務でAIを使い倒しているなら、その「違和感」は気のせいではないかもしれない。プロンプトに対する応答のニュアンス、コードの出力形式、あるいは拒否される基準──それらが昨日までと微妙に異なる。

今、技術コミュニティを騒がせている「GPTルーティング(Model Routing)」問題。

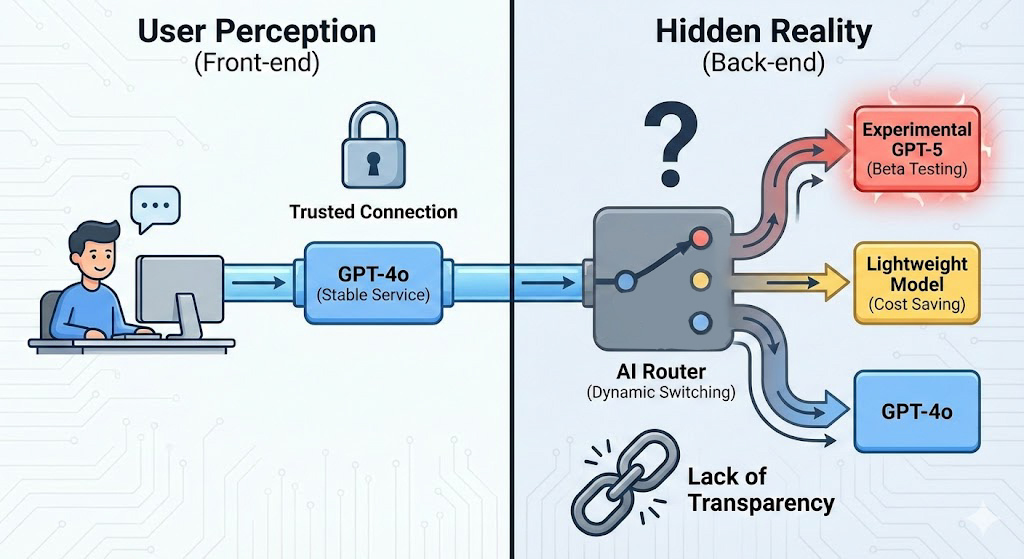

これは単なるバグではない。あなたが「GPT-4o」を使っていると信じているその裏側で、サービス提供者が勝手に別のAIモデル(例えばテスト段階のGPT-5や、軽量化されたモデル)へ接続先を切り替えているという疑惑だ。

なぜこれが、単なる「仕様変更」ではなく「信頼の崩壊」と呼ばれるのか?

本記事では、この不透明な「ブラックボックス化」の実態と、FTC(連邦取引委員会)も注視する法的リスク、そして私たちユーザーが取るべき自衛策について、技術と倫理の両面から徹底解説する。

1. 「GPTルーティング」の正体:なぜモデルは勝手に切り替わるのか

まず、技術的な背景を整理しよう。「ルーティング」自体は、本来効率化のための技術だ。

クラウドAIのコスト構造は極めてシビアである。すべてのクエリに最高性能のモデル(仮にGPT-5とする)を使っていては、計算リソースも電力も破綻する。そこで導入されるのが「動的計算(Dynamic Compute)」や「モデルルーター」と呼ばれる仕組みだ。

- 簡単な質問(「こんにちは」「天気を教えて」) → 軽量モデル(4o-mini等)へ

- 複雑な推論(「量子力学の解説」「複雑なコード生成」) → 高性能モデルへ

この振り分け自体は合理的だ。しかし、今回の騒動の核心はそこではない。

「ユーザーへの告知なしに、同意していないモデル(未完成のGPT-5など)のA/Bテスト実験台にされている」という点にある。

「Keep4o(GPT-4oの挙動を固定化しようとするユーザー主導の試み)」が話題になった背景には、業務フローに組み込んだプロンプトが、モデルの勝手な切り替えによって突然機能しなくなるという、実務上の深刻な損害があるのだ。

2. 「透明性」の欠如が招く法的リスク:FTC法第5条の影

技術的には「最適化」であっても、消費者心理としては「欺瞞(ぎまん)」と映る。ここで浮上するのが、アメリカの連邦取引委員会(FTC)法第5条だ。

この法律は「不公正または欺瞞的な行為・慣行」を禁じている。

もしサービス提供者が「あなたは最高品質のGPT-4oを使用しています」と表示しつつ、裏側で実験的な(あるいは劣化した)モデルを提供していたとしたら? それは「Bait-and-Switch(おとり商法)」の一種と見なされる可能性がある。

- ユーザーの認識: 「安定したGPT-4oに対価を払っている」

- 実態: 「不安定なGPT-5(ベータ版)のテストデータ収集に使われている」

この乖離(かいり)こそが、SNSでの集団的な抗議運動や、テンプレート化されたFTCへの報告活動へとつながっている。ユーザーは単に「性能」に怒っているのではない。「説明責任の放棄」に対して、デジタル時代の市民運動として声を上げているのだ。

3. 私たちが取るべき対策:ブラックボックスの中でどう振る舞うか

では、私たちユーザーはこの状況にどう対応すればいいのか?

ただ運営を批判していても、明日の業務は待ってくれない。以下に、プロフェッショナルが取るべき現実的なアプローチを提示する。

A. Web UIではなく「API」を利用する

Webインターフェース(ChatGPTの画面)は、どうしても運営側のA/Bテストの影響を受けやすい。

一方、API経由での利用(OpenAI APIなど)は、モデル名(例: gpt-4o-2025-xx-xx)を指定してコールするため、比較的「モデル固定」の信頼性が高い。

業務クリティカルなタスクは、APIを利用したツールや環境へ移行することを推奨する。

B. 「指紋」を確認する

AIモデルには、特定の質問に対して特有の答え方をする「指紋(Fingerprint)」のような癖がある。

定期的にベンチマークとなる同じプロンプト(「特定のロジックパズル」や「独特な詩の作成」など)を入力し、出力傾向が変わっていないか定点観測する。これで「サイレント・ルーティング」を早期に検知できる。

C. 代替手段の確保

特定のプラットフォームに依存しすぎないことだ。

Claude(Anthropic)やGemini(Google)、あるいはローカルLLMなど、複数の選択肢を常に手元に用意しておく。これが、不安定な過渡期における最大のリスクヘッジとなる。

まとめ

GPTルーティング問題は、AIサービスのフェーズが「魔法のような体験」から「実用インフラ」へと移行したことの証左でもある。インフラである以上、水道や電気と同じく、そこには「安定性」と「透明性」が求められる。

技術の進化は速い。今日使っていた「最強のツール」が、明日も同じ挙動をする保証はどこにもない。

だからこそ、サービス提供者に倫理観を求めると同時に、私たち自身も「裏側で何が起きているか」を常に想像し、一つのカゴにすべての卵を盛らない賢明さが必要だ。

信頼は揺らいでいる。だが、それを嘆くよりも、その揺らぎを前提とした「堅牢なワークフロー」を築くことこそが、今の私たちにできる最善の一手ではないだろうか。